Home » intelligenza artificiale

Category Archives: intelligenza artificiale

Papa Francesco sull’Intelligenza Artificiale: uso etico e responsabile al servizio dell’umanità

Quali effetti può produrre l’intelligenza artificiale sul futuro dell’umanità e perché non bisogna demonizzare questi modelli, piuttosto gestirli. Partono da qui alcune riflessioni di Papa Francesco al Summit dei leader del G7 sotto presidenza italiana in Puglia il 14 giugno scorso. L’evento ha visto la partecipazione dei Capi di Stato e di Governo dei sette Stati membri, oltre al Presidente del Consiglio Europeo e alla Presidente della Commissione Europea in rappresentanza dell’Unione Europea.

Rivoluzione cognitivo-industriale e creazione di un nuovo ordine sociale

“La scienza e la tecnologia” ha sostenuto il Pontefice “nascono dal potenziale creativo degli uomini da cui nasce l’IA. Queste tecnologie sono utilizzate in diverse aree dell’agire umano: dalla medicina, al lavoro, dalla cultura alla comunicazione, dall’educazione alla politica. È lecito quindi ipotizzare che il suo impatto condizionerà il nostro modo di vivere, le relazioni sociali e in futuro la maniera con la quale concepiamo la nostra identità di esseri umani. L’IA è percepita oggi ambivalente, da un lato affascina per le numerose applicazioni, dall’altro genera timore per le sue conseguenze. Senza dubbio – ha detto il Papa – rappresenta una rivoluzione cognitivo industriale e in futuro sarà responsabile della creazione di un nuovo ordine sociale e da complesse trasformazioni epocali.

Vantaggi e svantaggi per l’umanità

Nell’analizzare gli effetti positivi dell’IA, il Papa evidenzia una maggiore democratizzazione all’accesso dei saperi, un avanzamento nella ricerca scientifica, fino alla possibilità di delegare alle macchine i lavori più usuranti. Al contrario potrebbe far emergere ingiustizie tra nazioni avanzate e quelle in via di sviluppo, fra ceti sociali dominanti e ceti oppressi, mettendo in pericolo la possibilità di una cultura dell’incontro a vantaggio di una cultura dello scarto. L’importanza di tale progresso rende l’intelligenza artificiale uno strumento delicato che impone una riflessione all’altezza della situazione. Il Pontefice rileva che l’IA può restituire vantaggi all’umanità, e che tali benefici si sono sempre verificati per gli utensili costruiti dall’uomo, come la capacità di aver mantenuto un legame con l’ambiente per gli oggetti che produceva. Gli esseri umani vivono una condizione di priorità rispetto all’essere biologico; l’uomo è aperto agli altri e la creatività si estrinseca in termini di cultura e bellezza. Tuttavia, l’uso di questi strumenti non sempre è rivolto al bene, occorre che siano al servizio dell’umanità, solo così potranno rivelare la grandezza dell’uomo per custodire il pianeta e i suoi abitanti.

No a tecniche algoritmiche indipendenti ma decisione finale resta all’uomo

Il Pontefice osserva che l’IA è un mezzo sui generis che processa analisi algoritmiche, ovvero fa una scelta tecnica tra più possibilità, si basa su criteri definiti o differenze statistiche. L’essere umano invece ha la capacità di decidere, e davanti ai prodigi delle macchine che possono adottare scelte autonome, occorre avere chiaro che solo all’individuo resta la determinazione finale anche se questa assume toni drammatici nella nostra vita. “Se venisse tolta tale possibilità” ha detto “si condannerebbe l’uomo ad una vita senza speranza dove le persone sarebbero costrette a dipendere dalle macchine”. Per evitare che ciò accada – dice Francesco – è necessario garantire uno spazio di controllo significativo sul processo di scelta dei programmi di IA poiché ne va della stessa dignità dell’uomo. Al vertice del G7 il Pontefice ha poi parlato del dramma dei conflitti armati sostenendo che è necessario riflettere sullo sviluppo e uso di questi dispositivi, ripensare alle armi letali autonome vietandone l’uso attraverso un controllo dell’uomo. Ha infine sottolineato la necessità di rimettere al centro la dignità della persona in vista di una proposta etica condivisa, poiché si sta attraversando una particolare congiuntura sociale dove emerge lo smarrimento e la scarsa importanza della dignità dell’uomo.

Innovazione e scienza “non neutrale” nella società

“Nessuna innovazione è neutrale” ha detto il Pontefice “la tecnologia nasce per avere un impatto sulla società, definisce una forma di ordine nelle relazioni sociali che abilita qualcuno a compiere azioni e impedisce ad altri di compierne altre”. Tale sistema di poteri include in modo più o meno esplicito una visione del mondo e questo vale per i programmi di IA che devono avere un’ispirazione etica ed essere utilizzati per la costruzione del bene comune. A riguardo ricorda la firma nel 2020 del documento sulla “Rome call for Ai ethics” (Appello della Rome Call for AI Ethics) che incoraggia alla moderazione di tali programmi che ha battezzato algoretica. Per il pontefice è possibile aderire a questi principi anche in un contesto globale in cui esistono sensibilità e gerarchie plurali diverse nelle scale dei valori, ma nell’analisi etica si può ricorrere ad altri strumenti per affrontare dilemmi o conflitti del vivere.

Serve buona politica per un mondo nuovo e fruttuoso

Altra questione cui ha fatto riferimento riguarda il ruolo della politica, che definisce necessaria, di cui c’è bisogno. Il paradigma tecnologico che si incarna nell’intelligenza artificiale rischia di cedere il passo al paradigma democratico. Per questo Francesco definisce l’azione politica importante, poiché attraverso la sua opera si può trovare una via verso la fraternità universale e la pace sociale giacché rappresenta la forma più alta di amore. “La società mondiale mostra oggi gravi carenze strutturali, solo la buona politica può indicare la via per un progetto politico, sociale e culturale comune ed aprire opportunità differenti canalizzando l’uso dell’IA per un nuovo mondo possibile e fruttuoso”.

Cristina Montagni

Ricercatori e sviluppatori per l’utilizzo dell’IA a supporto del lavoro parlamentare. Call pubblica e presentazione dei progetti entro il 31 maggio

In questo 2024 di presidenza italiana del G7, la Camera ha portato il suo contributo in relazione allo sviluppo della tecnologia IA applicata al lavoro per la democrazia, interpellando giovani sviluppatori in una call pubblica orientata ad analizzare idee e progetti per il futuro.

Durante l’evento di fine febbraio la presidenza della Camera dei deputati ha presentato il rapporto: “L’Intelligenza artificiale a supporto del lavoro parlamentare: chiamata a giovani sviluppatori per nuovi progetti a servizio dei cittadini”, con l’invito a ricercatori e studiosi a contribuire al processo di queste tecnologie. Al dibattito erano presenti il presidente della Camera, Lorenzo Fontana, la presidente del Comitato e vicepresidente della Camera, Anna Ascani, i professori Paolo Benanti, Rita Cucchiara, Gianluca Misuraca che hanno illustrato i profili etici e tecnologici alla base delle proiezioni di sviluppo e utilizzo dell’IA generativa.

Bando e manifestazione d’interesse della Camera dei deputati

Per l’importanza del tema la Camera dei deputati ha lanciato una manifestazione d’interesse in grado di raccogliere proposte per l’uso dell’IA generativa su tre ambiti: 2 Call for Proposal e 1 Call for Ideas. La prima si riferisce alla definizione di strumenti per supportare la predisposizione dell’amministrazione alla documentazione parlamentare, con particolare riguardo alla comparazione. L’altro elemento attiene alla definizione di strumenti di supporto alla disposizione degli atti dei parlamentari. Quello che viene chiesto nella call è definire uno strumento che consenta al parlamentare di scrivere gli atti potendo contare sul migliore patrimonio informativo e ricostruzione del contesto. Il terzo ambito della Call for Ideas indica una richiesta meno avanzata rispetto agli ambiti precedenti. I partecipanti sono chiamati a presentare idee e proposte per aumentare la trasparenza e l’accountability delle istituzioni attraverso l’IA generativa, consentendo l’utilizzo della documentazione parlamentare da parte dei cittadini in modo completo e inclusivo. Alla call possono partecipare ricercatori impegnati in corsi universitari, centri di competenze universitarie ed enti di ricerca inviando le proposte entro il 31 maggio prossimo. Per ciascuno di questi ambiti, il comitato insieme ad una commissione tecnica di esperti, individuerà la proposta migliore che potrà essere usata per lo sviluppo di soluzioni per l’applicazione dell’IA generativa all’interno della Camera dei deputati. I vincitori saranno annunciati a luglio e i dettagli della call sono disponibili in formato cartaceo e pubblicati on-line sul sito della Camera dei deputati. L’importanza di aprirsi al mondo accademico insieme al contributo di ricercatori ed esperti, è fondamentale per definire applicazioni sicure dal punto di vista dei dati e rispettosi dei principi che sono alla base dell’Artificial intelligence Act.

IA a supporto del lavoro parlamentare

Il rapporto, grazie a studi e indagini conoscitive, approfondisce alcuni aspetti sull’uso etico-sociale degli strumenti di IA. “Siamo difronte ad una svolta epocale per la storia dell’umanità” ha detto Fontana “le nuove forme di intelligenza artificiale non sono solo un traguardo tecnologico, ma un ponte verso il futuro dove vengono ridefiniti i rapporti tra l’uomo e gli strumenti a disposizione”. Se la complessità delle tecnologie da un lato accresce l’efficienza e la produttività del lavoro, dall’altro mostra criticità perché, se l’IA tenta di imitare l’uomo nella fase di apprendimento, ragionamento, pianificazione e creatività non può sostituirsi ad esso, deve rimanere un mezzo a servizio dell’umanità e non viceversa. Per rispondere a queste caratteristiche l’IA deve essere aperta, trasparente e coinvolgere banche, dati per addestrarla, risorse economiche, ed energia per alimentare IA, fattori che hanno la capacità di ridisegnare i rapporti di forza fra i paesi. Nasce quindi l’esigenza di normare a livello sovranazionale un quadro legislativo capace di disciplinare il settore nel rispetto dei valori umani fondamentali. Il tema verrà affrontato anche in occasione dell’agenda della Presidenza italiana del G7 e al G7 dei parlamenti il prossimo settembre a Verona. La Camera è consapevole dei rischi legati all’uso di questi mezzi, ma è convinta che può essere un’opportunità per mettere al centro la persona verso un uso responsabile che richiede una riflessione etica. Questo percorso porterà anche a valorizzare il patrimonio legislativo dell’informazione contribuendo a fissare una strada tutta italiana nell’uso di queste tecnologie, dove la Camera intende promuovere in diverse sedi una maggiore conoscenza per tutti.

IA nel rispetto dei diritti e delle libertà fondamentali

“L’incontro” ha spiegato Ascani “è frutto di un intenso lavoro iniziato nel 2023 con la convinzione che l’IA può migliorare le attività umane, ma va governata per evitare pericoli legati alla sicurezza dei dati e all’affidabilità delle informazioni”. “Una sfida” ha detto “da affrontare con impegno e l’Italia deve studiare questi sistemi senza pregiudizi, minimizzando i rischi e massimizzando le opportunità a beneficio dei cittadini”. Il ruolo della politica è centrale per approfondire gli sviluppi tecnologici che investono l’uomo, i talenti, le necessità e le sue fragilità, per questo sono stati chiamati esperti e professionisti per comprenderne le potenzialità, le implicazioni etiche e socio-economiche. Nell’ultimo anno l’IA generativa è entrata nelle nostre vite diventando uno strumento pervasivo in grado di apprendere grandi quantità di dati, portando alla creazione sistemi che in alcuni campi superano le capacità umane. Da un indagine condotta con 13 esperti e una missione negli USA, è emerso quanto sta accadendo, rendendo chiara la necessità di una regolamentazione tecnologicamente neutrale capace di normare l’utilizzo preservando i diritti dei cittadini e la stabilità delle democrazie. Il rapporto pubblicato sul sito della Camera analizza queste criticità in quattro sezioni: nella prima è riportata la sintesi delle audizioni elaborate dagli uffici della Camera secondo un metodo tradizionale. Successivamente è stata sperimentata la soluzione con il LLM (Large Language Model); modelli linguistici dell’IA generativa per ottenere punti di convergenza e divergenza degli esperti. Nella seconda sezione sono riportati approfondimenti dei professori Paolo Benanti, Rita Cucchiara e Gianluca Misurata rispetto ai profili etici e tecnologici. Nella terza parte, dopo una ricostruzione con l’intelligenza artificiale, è stata inserita una panoramica delle prassi internazionali dell’IA in ambito parlamentare. Infine, nell’ultimo segmento sono trattati i principi che il comitato ritiene debbano essere rispettati per un uso corretto dell’IA che riguardano trasparenza, integrità informativa, responsabilità umana, formazione, competenza e consapevolezza, partecipazione pubblica, sicurezza e robustezza, interesse pubblico e prevenzione delle interferenze. Anna Ascani ha ribadito la necessità di mantenere un approccio antropocentrico e spiega che questa indagine è la prima in Europa ad elaborare una sperimentazione specifica all’interno di un’istituzione parlamentare. Infine, ha aggiunto che questo è solo l’inizio di un percorso, poiché l’uso dell’IA è un’opportunità per aumentare l’efficacia del lavoro parlamentare e la trasparenza verso i cittadini.

Etica della tecnologia: benefici nella geopolitica internazionale

L’accelerazione sull’IA è paragonabile a quella della stampa all’interno del contesto pubblico, ma la domanda da porsi è se questo tipo di organizzazione produrrà effetti nel contesto sociale. “L’etica della tecnologia” ha affermato Benanti “sa che dove si realizzano forme tecnologiche in ambito sociale, queste producono effetti nel sistema sociale stesso”. L’ultima innovazione usata durante la pandemia è stata una forma di accesso al vaccino pesata all’interno della popolazione che ha declinato il diritto alla salute in maniera algoritmicamente mediata. La campagna ha dimostrato che quando si opera secondo i principi della rule of law (stato di diritto), l’innovazione assume i tratti dello sviluppo umano. Un altro principio riguarda la natura della tecnologia che abbiamo di fronte. Nella storia dell’innovazione si conoscono forme di tecnologia che hanno risposto in maniera efficiente a diversi bisogni dell’umanità, ma esistono momenti in cui le tecnologie riferite all’energia a vapore, energia chimica, energia elettrica non servono a fare qualcosa, ma cambiano il modo con cui vengono fatte le cose. Ecco perché la Camera si sta interrogando su come questi strumenti possono modificare l’esercizio della democrazia come è il caso del Large Language Model, in grado di comprendere testi e distribuirli all’interno di un sistema sociale; una forma “digitale” che converte un atto legislativo in un linguaggio accessibile ai cittadini e ai parlamentari in modo efficace. Sul piano etico questi mezzi pongono limiti insieme alla possibilità di istruire l’intelligenza artificiale con sentenze emesse dall’organo giudiziale di un paese. Queste condizioni mettono insieme un diritto fondamentale, un diritto alla trasparenza degli atti amministrativi con la sfida che l’IA potrebbe includere da parte di un giudice una forma di giudizio o trovare dei vulnus. Introdurre un nuovo sistema tecnologico, induce quindi a riflettere su come i valori del passato possano essere in tensione con i valori del presente; e la trasparenza e la conoscenza della legge è il vincolo che potrebbe causare preoccupazioni per la capacità di qualcuno di alterarne il funzionamento. Dal lato dei benefici, questi strumenti sarebbero di aiuto nel contesto Mediterraneo ed europeo; la loro conoscenza faciliterebbe paesi come i Balcani ad inserirsi all’interno dell’Unione Europea attraverso l’armonizzazione dei sistemi giuridici alle necessità europee. Benefici che si riflettono a paesi a noi vicini nell’acquisire lo status di membri della comunità europea e aprirebbero risvolti positivi dal punto di vista geopolitico internazionale.

Società dell’informazione a supporto delle decisioni

“L’intelligenza artificiale” ha spiegato Rita Cucchiara “sta cambiando la vita delle persone e non riguarda solo il sistema informatico, ma abbraccia temi sociali, economici e geopolitici”. Nel 2014 quando uscì Deep Face – metodo per riconoscere le persone con un margine di errore sotto al 5% – creò problemi di democrazia per un uso massivo del sistema. Tra il 2016-2017 arrivano i primi sistemi generativi per produrre fake; dati sintetici con la possibilità di addestrare reti o sviluppare data set per il linguaggio e un sistema per generare parole e dati. Solo nel 2021 si comincia a parlare di modelli fondazionali; modelli che apprendono testi difformi che possono distillare la conoscenza secondo argomenti specifici come quelli della pubblica amministrazione. L’insieme di questi strumenti rappresenta però un problema geopolitico perché, se nella ricerca esiste collaborazione tra Europa, Stati Uniti e mondo asiatico, il panorama geopolitico è cambiato a livello sovranazionale dal momento che importanti aziende stanno impegnando investimenti per gestire la conoscenza e ciò può creare problemi di sovranità nelle nostre informazioni. Per quanto riguarda gli aspetti positivi, questi sistemi vengono già usati nella produzione industriale, in medicina, nella pianificazione urbanistica, nei beni culturali, nella pubblica amministrazione e nei lavori del Parlamento. Rita Cucchiara spiega che insieme all’intelligenza artificiale c’è quella discriminativa dove è possibile classificare documenti, categorizzarne delle parti, trovare le corrispondenze, recuperare atti attraverso informazioni semantiche rispetto a determinati argomenti e cercare la coerenza temporale delle decisioni prese negli anni dal Parlamento. Un altra questione dell’IA generativa è che può riprodurre risposte, sommari, sunti e informazioni che avrebbero bisogno di molto tempo per essere usati a livello documentale. Questi strumenti possono essere di supporto alle decisioni poiché non solo leggono testi, immagini, grafici, tabelle ma possono interpretare dati e fornire strumenti al legislatore per ipotizzare implicazioni di tipo sociale nel momento in cui si inseriscono nel contesto italiano. Un altro elemento, già utilizzato in modo non massivo, riguarda l’analisi del comportamento umano; il fatto che sistemi biometrici o strumenti di lip reading leggono e trasferiscono il linguaggio, è un esercizio che può essere usato in totale compliant della privacy perché i sistemi si possono concentrare su un soggetto oscurando altre attività. Infine, conclude Cucchiara ogni nazione deve avere la sua IA specchio della propria cultura, usi, valori, competenze e dati. La sfida dell’Italia è raggiungere questo obiettivo in tempi brevi ed è auspicabile la collaborazione con il resto del mondo per non perdere le opportunità di questi sistemi intelligenti.

La Camera si rivolge al mondo della ricerca e università per l’utilizzo dell’intelligenza artificiale a supporto del lavoro parlamentare. E’ possibile inviare i progetti scrivendo a manifestazione_ai@camera.it. Di seguito i dettagli della call per aderire.

Scarica la manifestazione d’interesse

Rapporto – Utilizzare l’intelligenza artificiale a supporto del lavoro parlamentare

Cristina Montagni

Monsignor Vincenzo Paglia riflette sull’IA generativa al servizio dell’umanità, un confine tracciato nel 2020 nella Rome Call for AI Ethics

Se il diritto alla privacy è irrinunciabile, minimizzare lo sviluppo umano rispetto all’innovazione e l’intelligenza artificiale è rischioso anche per l’impiego di algoritmi in grado di trasformare decisioni in campo sanitario, finanziario, giudiziario e politico. Questioni delicate intorno alle quali il futuro esorta a riflettere anche sul tema dell’assistenza agli anziani, che per la mancanza di servizi, riduce la possibilità di vivere l’invecchiamento in buona salute.

Questi alcuni temi trattati il 15 dicembre al summit “Digital Health by Design – Dati e IA” organizzato dal Ministero della Salute, da Culture con il Parlamento Europeo e la Commissione Europea con il patrocinio di ASL Rm2 e Rome Technopole. Tra i relatori, personalità del mondo istituzionale, accademico e imprenditoriale per tracciare una nuova visione di salute globale e delineare linee di azione per l’agenda 2024-2026.

Sistema sociale e sanitario una barriera da abbattere

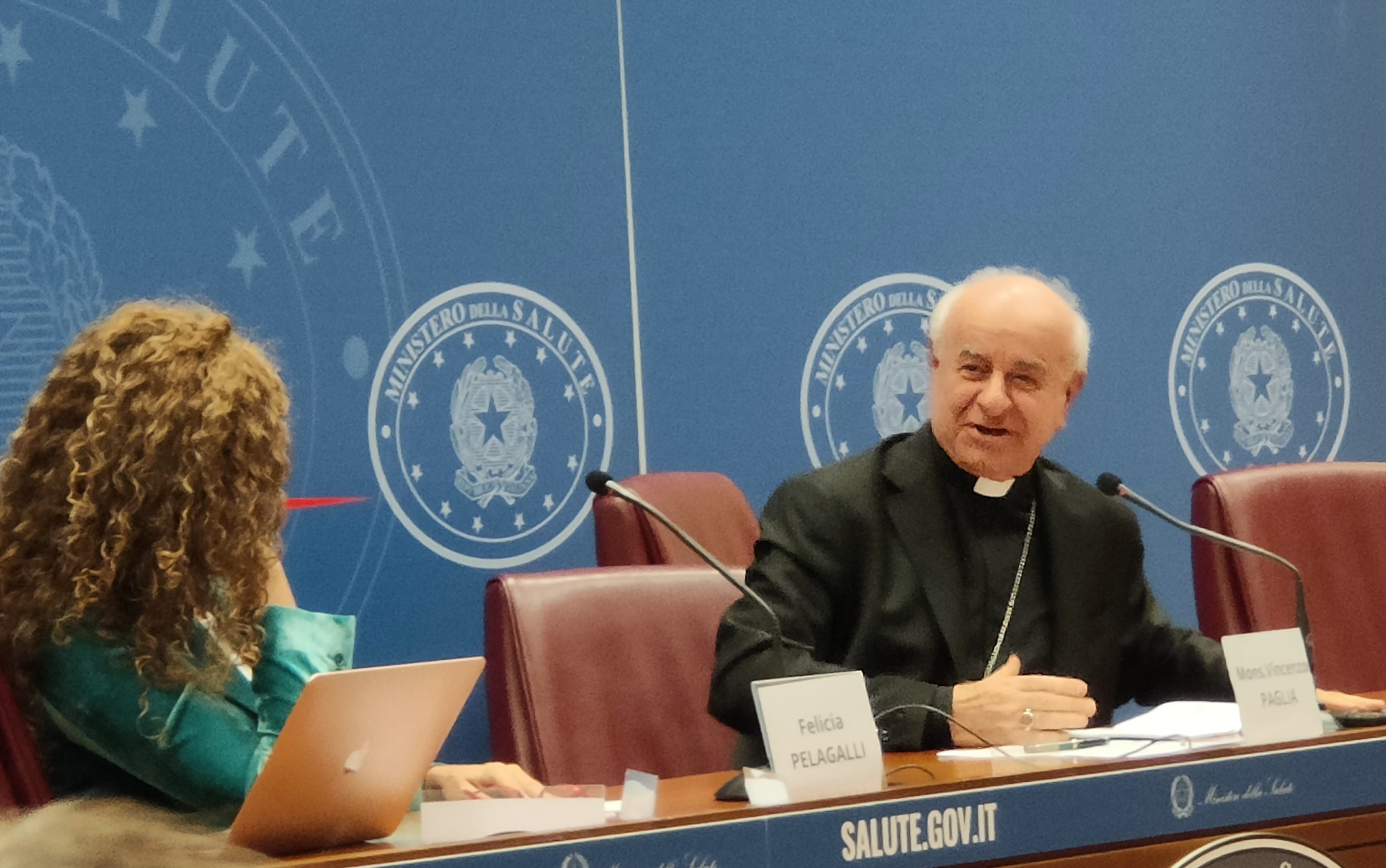

Monsignor Vincenzo Paglia Presidente della Pontificia Accademia per la Vita

Tra i numerosi contributi, il presidente della Pontificia Accademia per la Vita, Monsignor Vincenzo Paglia ha focalizzato il pensiero sul rapporto tra l’IA e anziani, che ricorda sono circa 14 milioni e per i quali non esiste una riflessione politica, economica né tantomeno sanitaria. È sufficiente pensare che i presidi ad uso farmaceutico vengono testati a persone tra i 20 e i 50 anni, mentre la popolazione di terza età è a rischio per l’enorme quantità di farmaci somministrati. L’arcivescovo ha commentato che, se da un lato la società, lo sviluppo e la medicina hanno permesso un aumento della sopravvivenza di 20-30 anni, dall’altro lo stato sociale non è stato capace di occuparsi di loro e “non esiste alcun pensiero se non negativo”. Sottolinea di aver lavorato con il Governo italiano per definire una legge per gli anziani – approvata a marzo scorso – che non ha prodotto risorse in bilancio; ma di recente sono state intraprese alcune sperimentazioni. “Serve” chiarisce Mons. Paglia “promuovere una responsabilità morale nel creare un’età degna per coloro che verranno dopo di noi e una consapevolezza dello Stato nel produrre leggi, così da superare la distinzione tra sistema sociale e sanitario”.

Una Parigi delle nuove tecnologie per circoscrivere i confini tra l’uomo e intelligenza artificiale

In relazione all’intelligenza artificiale, l’arcivescovo Paglia ricorda le parole dell’esperto di robotica Ishiguro, che durante un incontro ha affermato che potremmo essere l’ultima generazione organica, la prossima sarà inorganica. Paglia sostiene che usare il termine intelligenza è errato, perché mentre l’intelligenza umana è ascrivibile all’uomo, gli strumenti utilizzati con IA per concepire relazioni di affetto e amore hanno una dimensione non umana, come gli esperimenti per combattere la solitudine. Aggiunge che, “se un robot umanoide è capace di sconfiggere la solitudine, siamo difronte all’esplosione del sistema dove la contraddizione è lasciarsi guidare dalla macchina e non da chi l’ha costruita”. Dunque, è necessario circoscrivere i confini tra l’umano e la macchina e stabilire un quadro giuridico internazionale altrimenti i rischi saranno peggiori delle guerre nucleari. “L’impegno” sottolinea Mons. Paglia “è che si arrivi ad una Parigi delle nuove tecnologie onde evitare il rischio di una terza ondata drammatica dopo quella nucleare e dell’inquinamento climatico che può manipolare l’uomo e costruirlo a sua immagine e somiglianza”. La regolamentazione nell’uso di questi strumenti attiene anche al trasformatore generativo pre-addestrato ChatGPT che da un lato evidenzia l’enorme velocità d’implementazione della tecnica, dall’altro mostra la lentezza della cultura etica e della politica nel comprendere le conseguenze sulla vita delle persone e dell’intera umanità.

Appello della Rome Call for AI Ethics

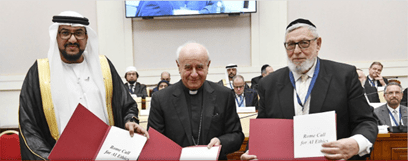

Relativamente al “gap” tra etica, Intelligenza artificiale e cognitiva, l’arcivescovo ricorda che con la Rome Call for AI Ethics, a febbraio 2020 è stato siglato un documento dalla Pontificia Accademia per la Vita (sponsor dell’iniziativa), Microsoft, IBM, FAO e Governo italiano, allargato ai rappresentanti di fede musulmana ed ebraica per sostenere un approccio etico all’Intelligenza Artificiale, promuovere un’antropologia digitale, con tre coordinate fondamentali: etica, educazione e diritto. L’obiettivo è guidare la tecnologia verso un nuovo umanesimo, un atto di autoregolamentazione di principi etici, pedagogici e giuridici, e chi lo firma si impegna ad osservare i criteri che definiscono il processo di costruzione dei meccanismi affinché siano visibili a tutti, inserendo anche la questione dei media nei ragazzi. La carta che verrà siglata a luglio 2023 da Giappone e altre religioni del mondo, con l’estensione a 200 università latino-americane, sottolinea quanto è necessario essere consapevoli di questa strumentazione che viene sperimentata anche nel settore militare per testare nuove strategie di guerra. “In campo sanitario – soprattutto per gli anziani – occorre abbracciare con entusiasmo questa tecnologia”, tuttavia spiega l’arcivescovo “serve un cambio di prospettiva e l’assistenza domiciliare deve diventare centrale con un maggiore uso della telemedicina per accudire a casa gli anziani che ne hanno necessità”. L’arcivescovo Vincenzo Paglia conclude che “una società civile non può permettere che gli anziani vengano considerati scarti. È una lotta di civiltà e l’IA può essere utile se noi siamo sapienti nel dirigerla verso un nuovo umanesimo planetario, che è l’unico orizzonte possibile, a meno che non vogliamo distruggerci”.

Firma documento Rome Call for AI Ethics

Cristina Montagni